1、概述

统计学方法假定正常的数据对象由一个统计模型产生,而不遵守该模型的数据是异常点。

统计学方法的有效性高度依赖于统计模型假定是否成立。

异常检测的统计学方法的一般思想是:学习一个拟合给定数据集的生成模型,然后识别该模型低概率区域中的对象,把它们作为异常点。

类似于统计学思想,可以用深度学习中的Encoder-Decoder方式来做异常检测。

如果样本输入给Encoder-Decoder,很难还原,那么我们就认为样本是异常的。

统计学方法首先建立一个模型,然后考虑具体样本符合该模型的概率。

异常检测的统计学方法可以划分为两个主要类型:参数方法和非参数方法。

参数方法假定正常的数据对象被一个以$\Theta$为参数的参数分布产生。该参数分布的概率密度函数$f(x,\Theta)$给出对象$x$被该分布产生的概率。该值越小,$x$越可能是异常点。

非参数方法并不假定先验统计模型,而是试图从输入数据确定模型。非参数方法通常假定参数的个数和性质都是灵活的,不预先确定(所以非参数方法并不是说模型是完全无参的,完全无参的情况下从数据学习模型是不可能的)。

2、参数方法

2.1 基于正态分布的一元异常点检测

仅涉及一个属性或变量的数据称为一元数据。我们假定数据由正态分布产生,然后可以由输入数据学习正态分布的参数,并把低概率的点识别为异常点。

假定输入数据集为$\{x^{(1)}, x^{(2)}, ..., x^{(m)}\}$,数据集中的样本服从正态分布,即$x^{(i)}\sim N(\mu, \sigma^2)$,我们可以根据样本求出参数$\mu$和$\sigma$。

$$ \begin{aligned}\mu=&\frac 1m\sum_{i=1}^m x^{(i)}\\ \sigma^2=&\frac 1m\sum_{i=1}^m (x^{(i)}-\mu)^2 \end{aligned} $$

求出参数之后,我们就可以根据概率密度函数计算数据点服从该分布的概率。正态分布的概率密度函数为

$$ p(x)=\frac 1{\sqrt{2\pi}\sigma}exp(-\frac{(x-\mu)^2}{2\sigma^2}) $$

如果计算出来的概率低于阈值,就可以认为该数据点为异常点。

阈值是个经验值,可以选择在验证集上使得评估指标值最大(也就是效果最好)的阈值取值作为最终阈值。

例如常用的3$\sigma$原则中,如果数据点超过范围$(\mu-3\sigma, \mu+3\sigma)$,那么这些点很有可能是异常点。

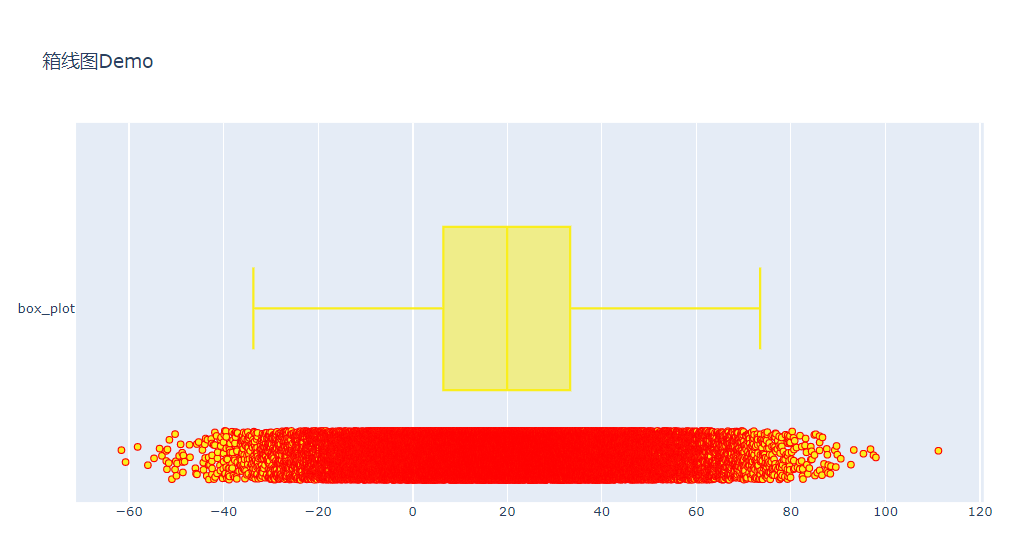

这个方法还可以用于可视化。箱线图对数据分布做了一个简单的统计可视化,利用数据集的上下四分位数($Q_1$和$Q_3$)、中点等形成。异常点常被定义为小于$Q_1-1.5IQR$或大于$Q_3+1.5IQR$的那些数据。

用plotly画一个简单的箱线图:

import plotly.offline as of

import plotly.graph_objs as go

import numpy as np

x = np.random.randn(50000) * 20 + 20

trace0 = go.Box(

x = x,

name = 'box_plot',

boxpoints = 'all',

jitter = 0.3,

pointpos = -1.8,

marker = dict(

color = '#faee1c',

line = dict(

color = 'red',

width = 1

)

)

)

data = [trace0]

layout = go.Layout(

title = '箱线图Demo'

)

fig = go.Figure(data=data, layout=layout)

of.init_notebook_mode()

of.iplot(fig)

2.2 多元异常点检测

涉及两个或多个属性或变量的数据称为多元数据。许多一元异常点检测方法都可以扩充,用来处理多元数据。其核心思想是把多元异常点检测任务转换成一元异常点检测问题。例如基于正态分布的一元异常点检测扩充到多元情形时,可以求出每一维度的均值和标准差。对于第$j$维:

$$ \mu_j=\frac 1m\sum_{i=1}^m x_j^{(i)}\\ \sigma_j^2=\frac 1m\sum_{i=1}^m (x_j^{(i)}-\mu_j)^2 $$

计算概率时的概率密度函数为

$$ \begin{aligned} p(x)&=\prod_{j=1}^n p(x_j;\mu_j,\sigma_j^2)\\ &=\prod_{j=1}^n\frac 1{\sqrt{2\pi}\sigma_j}exp(-\frac{(x_j-\mu_j)^2}{2\sigma_j^2}) \end{aligned} $$

这是在各个维度的特征之间相互独立的情况下。如果特征之间有相关性,就要用到多元高斯分布了。

2.3 多个特征相关,且符合多元高斯分布

$$ \begin{aligned} \mu&=\frac{1}{m}\sum^m_{i=1}x^{(i)}\\ \Sigma&=\frac{1}{m}\sum^m_{i=1}(x^{(i)}-\mu)(x^{(i)}-\mu)^T\\ p(x)&=\frac{1}{(2 \pi)^{\frac{n}{2}}|\Sigma|^{\frac{1}{2}}} \exp \left(-\frac{1}{2}(x-\mu)^{T} \Sigma^{-1}(x-\mu)\right) \end{aligned} $$

当多元高斯分布模型的协方差矩阵$\Sigma$为对角矩阵,且对角线上的元素为各自一元高斯分布模型的方差时,二者是等价的。

3 使用混合参数分布

在许多情况下假定数据是由正态分布产生的。当实际数据很复杂时,这种假定过于简单,可以假定数据是被混合参数分布产生的。

例子:使用直方图检测异常点。

直方图是一种频繁使用的非参数统计模型,可以用来检测异常点。该过程包括如下两步:

步骤1:构造直方图。使用输入数据(训练数据)构造一个直方图。该直方图可以是一元的,或者多元的(如果输入数据是多维的)。

尽管非参数方法并不假定任何先验统计模型,但是通常确实要求用户提供参数,以便由数据学习。例如,用户必须指定直方图的类型(等宽的或等深的)和其他参数(直方图中的箱数或每个箱的大小等)。与参数方法不同,这些参数并不指定数据分布的类型。

步骤2:检测异常点。为了确定一个样本是否是异常点,可以对照直方图检查它。在最简单的方法中,如果该样本落入直方图的一个箱中,则该样本被看作正常的,否则被认为是异常点。

对于更复杂的方法,可以使用直方图赋予每个样本一个异常点得分。例如令样本的异常点得分为该样本落入的箱的容积的倒数。

使用直方图作为异常点检测的非参数模型的一个缺点是,很难选择一个合适的箱尺寸。一方面,如果箱尺寸太小,则许多正常对象都会落入空的或稀疏的箱中,因而被误识别为异常点。另一方面,如果箱尺寸太大,则异常点对象可能渗入某些频繁的箱中,因而“假扮”成正常的。

4 基于角度的方法

基于角度的方法的主要思想是:数据边界上的数据很可能将整个数据包围在一个较小的角度内,而内部的数据点则可能以不同的角度围绕着他们。如下图所示,其中点A是一个异常点,点B位于数据内部。

如果数据点与其余点离得较远,则潜在角度可能越小。因此,具有较小角度谱的数据点是异常值,而具有较大角度谱的数据点不是异常值。

考虑三个点X,Y,Z。如果对于任意不同的点Y,Z,有:

$$ W \operatorname{Cos}(\overrightarrow{X Y}, \overrightarrow{X Z})=\frac{\langle\overline{X Y}, X Z\rangle}{\|X Y\|\|X Z\|} $$

其中$||\space||$代表L2范数 , $< · > $代表点积。

这是一个加权余弦,因为分母包含L2-范数,其通过距离的逆加权进一步减小了异常点的加权角,这也对角谱产生了影响。然后,通过改变数据点Y和Z,保持X的值不变计算所有角度的方法。相应地,数据点X的基于角度的异常分数(ABOF)∈ D为:

$$ A B O F(X)=\operatorname{Var}_{\{Y, Z \in D\}} W \operatorname{Cos}(\overrightarrow{X Y}, \overrightarrow{X Z}) $$

5 HBOS

参考之前的文章:

6 总结

1.异常检测的统计学方法由数据学习模型,以区别正常的数据对象和异常点。使用统计学方法的一个优点是,异常检测可以是统计上无可非议的。当然,仅当对数据所做的统计假定满足实际约束时才为真。

2.HBOS在全局异常检测问题上表现良好,但不能检测局部异常值。但是HBOS比标准算法快得多,尤其是在大数据集上。

7 补充

画直方图的代码为:

import os

import sys

import plotly.offline as of

import plotly.graph_objs as go

import numpy as np

from pyod.models.hbos import HBOS # HBOS模型类

from pyod.utils.data import generate_data # 生成假数据

from pyod.utils.data import evaluate_print # 衡量指标print

from pyod.utils.example import visualize #可视化

contamination = 0.1 # 异常样本的比例

n_train = 200 # 训练样本数

n_test = 100 # 测试样本数

# 生成数据

X_train, X_test, y_train, y_test = generate_data(

n_train=n_train,

n_test=n_test,

n_features=1,

contamination=contamination,

random_state=42,

behaviour='new'

)

X_train = X_train.reshape(-1)

trace0 = go.Histogram(

x = X_train,

histnorm = 'probability'

)

data = [trace0]

layout = go.Layout(

title = 'Histogram'

)

fig = go.Figure(data=data, layout=layout)

of.init_notebook_mode()

of.iplot(fig)